Violence, sexe, spam: YouTube supprime 8,2 millions de vidéos en trois mois

YouTube a retiré plus de 8 millions de vidéos entre octobre et décembre 2017 - Sous licence Creative Commons CC0

YouTube continue de vouloir redorer son image après d’importantes critiques liées aux dérives de sa plateforme. Une enquête du Times avait révélé l'an dernier que des bannières publicitaires apparaissaient près de contenus violents, racistes, antisémites, terroristes et homophobes.

En décembre, Susan Wojcicki, la PDG du service de Google, avait annoncé une série de mesures avec notamment la création d’une équipe de 10.000 modérateurs. YouTube a publié ce lundi son premier rapport sur la mise en application du Règlement de la communauté. Un compte-rendu sera désormais publié chaque trimestre.

Vidéos à caractère sexuel et spams

Plus de 8,2 millions de vidéos ont été supprimées de la plateforme entre octobre et décembre 2017, indique le document. "Ces vidéos étaient majoritairement du spam ou des tentatives de publication de contenus réservés aux adultes", précise le rapport. "Elles représentent moins de 1% des vues totales de YouTube pendant cette période", ajoute-t-il.

Un tiers des vidéos supprimées présentaient un caractère sexuel. Viennent ensuite les contenus spams (26,4%), haineux (15,6%) et violents (13,5%). Celles faisant la promotion du terrorisme représentent 2% des suppressions, soit près de 165.000 vidéos.

Comment YouTube repère les vidéos à supprimer

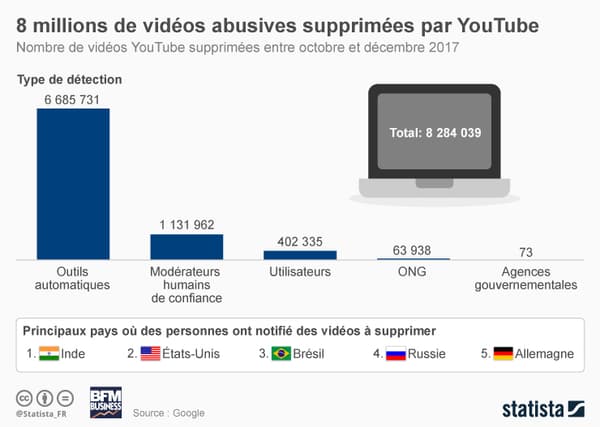

Pour repérer les vidéos suspectes, le service de Google se sert des signalements de ses utilisateurs. Ceux-ci pourront désormais consulter l’historique de leurs signalements dans un tableau de bord afin de voir où en est le processus de modération. Le pays qui émet le plus de signalements est l'Inde, suivi des États-Unis et du Brésil.

YouTube a également un réseau de partenaires universitaires, gouvernementaux et d'ONG. Leur nombre de signalements s'est élevé à 1,1 million sur la période allant d'octobre à décembre 2017, contre 400.000 pour les utilisateurs "ordinaires".

Mais la majorité des vidéos indésirables sont repérées par la machine. Depuis juin 2017, YouTube développe et entraîne des algorithmes à identifier et supprimer des contenus non réglementaires. Pour ce faire, la technologie analyse les titres, la description et les tags. "6,7 millions de vidéos ont d’abord été signalées grâce à l’apprentissage automatique", note le rapport. Au total, 75% d’entre elles ont été retirées avant qu’un utilisateur ne puisse les voir.

Retrouvez d'autres graphiques sur le site de Statista.